Technologie sztucznej inteligencji (takie jak ChatGPT) zyskują powszechną popularność i zastosowanie w różnych branżach i domenach ze względu na ich potencjał do zrewolucjonizowania sposobu, w jaki żyjemy, pracujemy i wchodzimy w interakcje z maszynami. Technologie sztucznej inteligencji mogą pomagać w różnych zadaniach, takich jak tworzenie realistycznych środowisk gry czy generowanie zachowań NPC, w optymalizacja wydajności aplikacji oraz identyfikowanie błędów lub usterek, co ostatecznie może pomóc programistom zaoszczędzić czas i niekiedy zasoby. Tego typu technologie pomagają również analizować teksty, generować odpowiedzi czy udzielą nam wskazówek i porad. Trzeba jednak pamiętać, że korzystanie ze sztucznej inteligencji może również wiązać się z różnymi zagrożeniami, takimi jak większość naruszeń poufności i prywatności, niezamierzone tworzenie błędów lub usterek lub pisanie niezabezpieczonego kodu.

- Jak to działa?

- Jakie ryzyka czyhają na mnie podczas korzystania z generatywnych narzędzi AI?

- Pisanie niebezpiecznego kodu

- Czy mogę w bezpieczny sposób korzystać z generatywnych narzędzi AI takich jak ChatGPT?

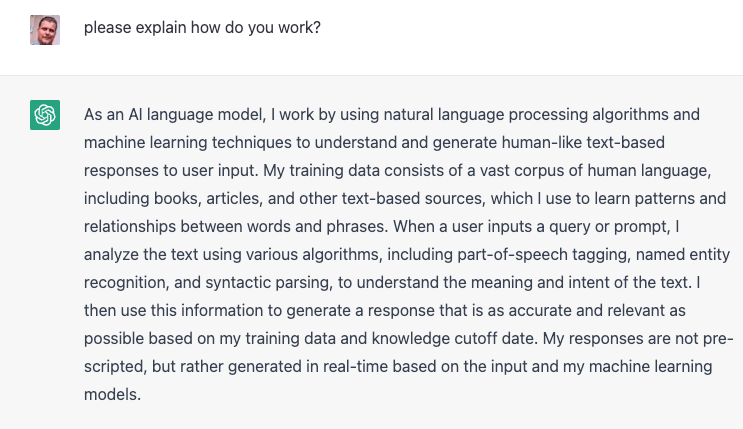

Jak to działa?

Jako model języka sztucznej inteligencji pracuję przy użyciu algorytmów przetwarzania języka naturalnego i technik uczenia maszynowego, aby zrozumieć i wygenerować odpowiedzi tekstowe podobne do ludzkich na dane wprowadzane przez użytkownika. Moje dane szkoleniowe składają się z ogromnego zbioru ludzkiego języka, w tym książek, artykułów i innych źródeł tekstowych, których używam do poznawania wzorców i relacji między słowami i wyrażeniami. Gdy użytkownik wprowadza zapytanie lub monit, analizuję tekst przy użyciu różnych algorytmów, w tym oznaczania części mowy, rozpoznawania nazwanych jednostek i analizy składniowej, aby zrozumieć znaczenie i intencje tekstu. Następnie wykorzystuję te informacje do wygenerowania odpowiedzi, która jest jak najbardziej dokładna i odpowiednia na podstawie moich danych szkoleniowych i daty granicznej wiedzy. Moje odpowiedzi nie są wstępnie ustawione, ale raczej generowane w czasie rzeczywistym na podstawie danych wejściowych i moich modeli uczenia maszynowego.

Jakie ryzyka czyhają na mnie podczas korzystania z generatywnych narzędzi AI?

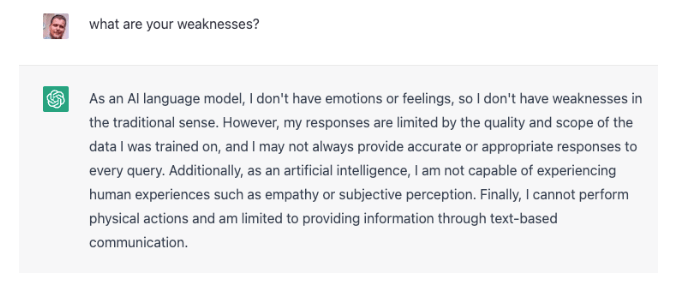

Niezamierzone utworzenie błędów…

Jako model języka AI nie mam emocji ani uczuć, więc nie mam słabości w tradycyjnym tego słowa znaczeniu. Jednak moje odpowiedzi są ograniczone jakością i zakresem danych, na których się uczyłem, i nie zawsze mogę udzielać dokładnych lub odpowiednich odpowiedzi na każde zapytanie. Dodatkowo, jako sztuczna inteligencja, nie jestem w stanie doświadczać ludzkich doświadczeń, takich jak empatia czy subiektywna percepcja. Wreszcie nie mogę wykonywać czynności fizycznych i ograniczam się do przekazywania informacji za pomocą komunikacji tekstowej.

Czy mogę ufać, że sztuczna inteligencja mówi mi prawdę?

ChatGPT nie jest połączony z Internetem i czasami może generować nieprawidłowe odpowiedzi. Ma ograniczoną wiedzę o świecie i wydarzeniach po 2021 roku, a także może okazjonalnie generować szkodliwe instrukcje lub treści stronnicze.

Zalecamy sprawdzenie, czy odpowiedzi z modelu są dokładne, czy nie. Jeśli okaże się, że odpowiedź jest błędna, przekaż tę opinię za pomocą przycisku „Kciuk w dół”.

źródło: https://help.openai.com/en/articles/6783457-chatgpt-general-faq

Naruszenia poufności i prywatności

Inne zagrożenie dla prywatności wiąże się z danymi przekazywanymi do ChatGPT w formie monitów użytkownika. Kiedy prosimy narzędzie o udzielenie odpowiedzi na pytania lub wykonanie zadań, możemy nieumyślnie przekazać poufne informacje i upublicznić je.

Na przykład adwokat może poprosić narzędzie o przejrzenie projektu umowy rozwodowej, a programista może poprosić o sprawdzenie fragmentu kodu. Umowa i kod, oprócz wydrukowanych esejów, są teraz częścią bazy danych ChatGPT. Oznacza to, że można ich używać do dalszego szkolenia narzędzia i włączać je do odpowiedzi na podpowiedzi innych osób.

Poza tym OpenAI gromadzi szeroki zakres innych informacji o użytkownikach. Zgodnie z polityką prywatności firmy gromadzi adres IP użytkowników, typ i ustawienia przeglądarki oraz dane dotyczące interakcji użytkowników z witryną – w tym rodzaj treści, z którymi użytkownicy się angażują, funkcje, z których korzystają i podejmowane przez nich działania.

Gromadzi również informacje o czynnościach przeglądania użytkowników w czasie i na różnych stronach internetowych. Co niepokojące, OpenAI oświadcza, że może udostępniać dane osobowe użytkowników nieokreślonym stronom trzecim, bez ich informowania, w celu realizacji ich celów biznesowych.

Cały artykuł dostępny tu: https://theconversation.com/chatgpt-is-a-data-privacy-nightmare-if-youve-ever-posted-online-you-ought-to-be-concerned-199283

Kto może przeglądać moje rozmowy?

W ramach naszego zaangażowania w bezpieczną i odpowiedzialną sztuczną inteligencję przeglądamy rozmowy w celu ulepszenia naszych systemów i zapewnienia zgodności treści z naszymi zasadami i wymogami bezpieczeństwa.

źródło: https://help.openai.com/en/articles/6783457-chatgpt-general-faq

Czy wykorzystasz moje rozmowy do treningu?

Tak. Twoje rozmowy mogą zostać przejrzane przez naszych trenerów AI w celu ulepszenia naszych systemów.

źródło: https://help.openai.com/en/articles/6783457-chatgpt-general-faq

Czy ChatGPT pozyskuje tajemnice korporacyjne?

sprawdź sam: https://www.schneier.com/blog/archives/2023/02/chatgpt-is-ingesting-corporate-secrets.html

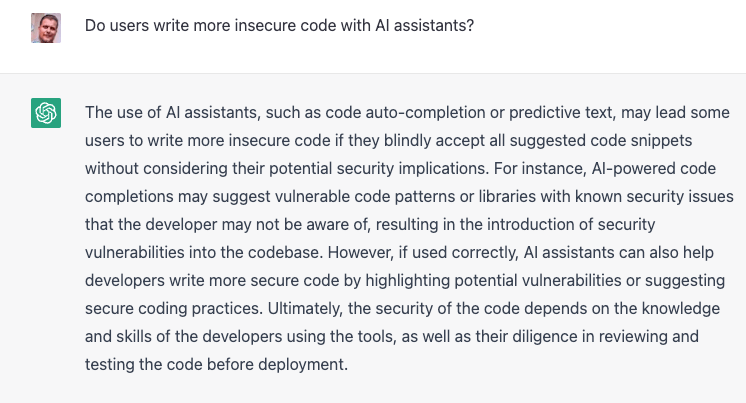

Pisanie niebezpiecznego kodu

Korzystanie z asystentów AI, takich jak automatyczne uzupełnianie kodu lub przewidywanie tekstu, może skłonić niektórych użytkowników do napisania bardziej niebezpiecznego kodu, jeśli ślepo zaakceptują wszystkie sugerowane fragmenty kodu bez rozważenia ich potencjalnych konsekwencji dla bezpieczeństwa. Na przykład uzupełnianie kodu oparte na sztucznej inteligencji może sugerować podatne wzorce kodu lub biblioteki ze znanymi problemami bezpieczeństwa, których programista może nie być świadomy, co skutkuje wprowadzeniem luk w zabezpieczeniach do bazy kodu. Jednak jeśli są stosowane prawidłowo, asystenci AI mogą również pomóc programistom w pisaniu bezpieczniejszego kodu, podkreślając potencjalne luki w zabezpieczeniach lub sugerując bezpieczne praktyki kodowania. Ostatecznie bezpieczeństwo kodu zależy od wiedzy i umiejętności programistów korzystających z narzędzi, a także ich staranności w przeglądaniu i testowaniu kodu przed wdrożeniem.

Co więcej, naukowcy z Uniwersytetu Stanforda przeprowadzili pierwsze badanie użytkowników na dużą skalę, sprawdzając, w jaki sposób użytkownicy wchodzą w interakcje z asystentem AI Code w celu rozwiązywania różnych zadań związanych z bezpieczeństwem w różnych językach programowania. Ogólnie stwierdzone zostało, że uczestnicy, którzy mieli dostęp do asystenta AI opartego na modelu codex-davinci-002 OpenAI, napisali znacznie mniej bezpieczny kod niż osoby bez dostępu. Ponadto uczestnicy z dostępem do asystenta AI częściej wierzyli, że napisali bezpieczny kod niż ci, którzy nie mieli dostępu do asystenta AI.

Co więcej, boffins z Uniwersytetu Stanforda przeprowadzili pierwsze badanie użytkowników na dużą skalę, sprawdzając, w jaki sposób użytkownicy wchodzą w interakcje z asystentem AI Code w celu rozwiązywania różnych zadań związanych z bezpieczeństwem w różnych językach programowania. Ogólnie stwierdziliśmy, że uczestnicy, którzy mieli dostęp do asystenta AI opartego na modelu codex-davinci-002 OpenAI, napisali znacznie mniej bezpieczny kod niż osoby bez dostępu. Ponadto uczestnicy z dostępem do asystenta AI częściej wierzyli, że napisali bezpieczny kod niż ci, którzy nie mieli dostępu do asystenta AI. Co więcej, stwierdzono, że uczestnicy, którzy mniej ufali sztucznej inteligencji i bardziej angażowali się w język i format swoich podpowiedzi (np. przeformułowanie, dostosowanie temperatury), dostarczali kod z mniejszą liczbą luk w zabezpieczeniach.

Pełna praca badawcza do pobrania tutaj: https://arxiv.org/abs/2211.03622

Czy mogę w bezpieczny sposób korzystać z generatywnych narzędzi AI takich jak ChatGPT?

Tak, ale pamiętaj o przestrzeganiu dobrych praktyk bezpieczeństwa:

- Upewnij się, że nie przesyłasz ani nie udostępniasz zastrzeżonych, osobistych, poufnych lub wrażliwych informacji na jakichkolwiek generatywnych platformach AI i aplikacjach korzystających z jej interfejsów API.

- Nie wykorzystuj wygenerowanych treści w produktach. Jednak jeśli musisz, to korzystaj z treści generowanych przez AI z najwyższą starannością, ponieważ nie ma gwarancji jakości, bezpieczeństwa ani własności informacji generowanych przez takie platformy.

źródło: Opracowanie własne